AIアート制作者の中には、Stable Diffusionをより正確に制御する方法として、ControlNetの使用方法に興味を持っている方もいるでしょう。Stable Diffusionモデルは、AIアーティストが画像を生成・操作する方法を変革しました。このモデルを使用すると、参照画像からの構図や人間のポーズをコピーすることができ、これまでにない精度を実現することができます。この記事では、ControlNetの使用方法、特に画像プロンプトアダプタに焦点を当て、AI画像をカスタマイズする方法について詳しく解説します。

ControlNetとは?

ControlNetは、Stable Diffusionモデルを制御するためのニューラルネットワークモデルです。テキストプロンプトに追加の条件を加えることで、SDXLモデルを使用する最も基本的な形態を提供します。この追加の条件は様々な形を取ることができ、ユーザーはAI生成画像を精密に操作することができます。ControlNetの画像プロンプトアダプタは、AI生成の顔を中心に人物や背景を作成したり、写真の人物の年齢や髪のタイプ、色を変更したり、デジタルアートの要素を変更するための強力なツールとなっています。

SDXLとControlNetを使用してAIアートをカスタマイズする方法

ControlNetとその画像プロンプトアダプタは、AI画像の操作と生成のための強力なツールを提供します。デジタルアートの要素を変更するためや、AI画像を再生成するため、顔画像から全身と環境を作成するなど、ControlNetを使用することでこれまでにない精度と制御を実現することができます。適切な知識とツールを持っていれば、画像の操作と生成の可能性はほぼ無限です。

ControlNetの使用方法

ControlNetを使用するには、Hugging Faceから3つのIPアダプタモデルとIPアダプタプラスフェイスモデルをダウンロードする必要があります。IPアダプタモデルは、安定した拡散のようなテキストベースの画像モデルのための画像プロンプトモデルであり、他のControlNetモデルと組み合わせて使用することができます。

IPアダプタモデルを使用するワークフローは、SDXLで参照AI画像を再生成し、正のプロンプトを使用して最終画像に要素を追加することを含みます。このプロセスにより、ControlNetを使用してデジタルアートの要素を変更することができます。たとえば、ユーザーは、ベースのAI画像の髪を変更するためにインペインティングを使用し、別のベース画像から顔をインペインティングすることができます。

ControlNetの強力な機能

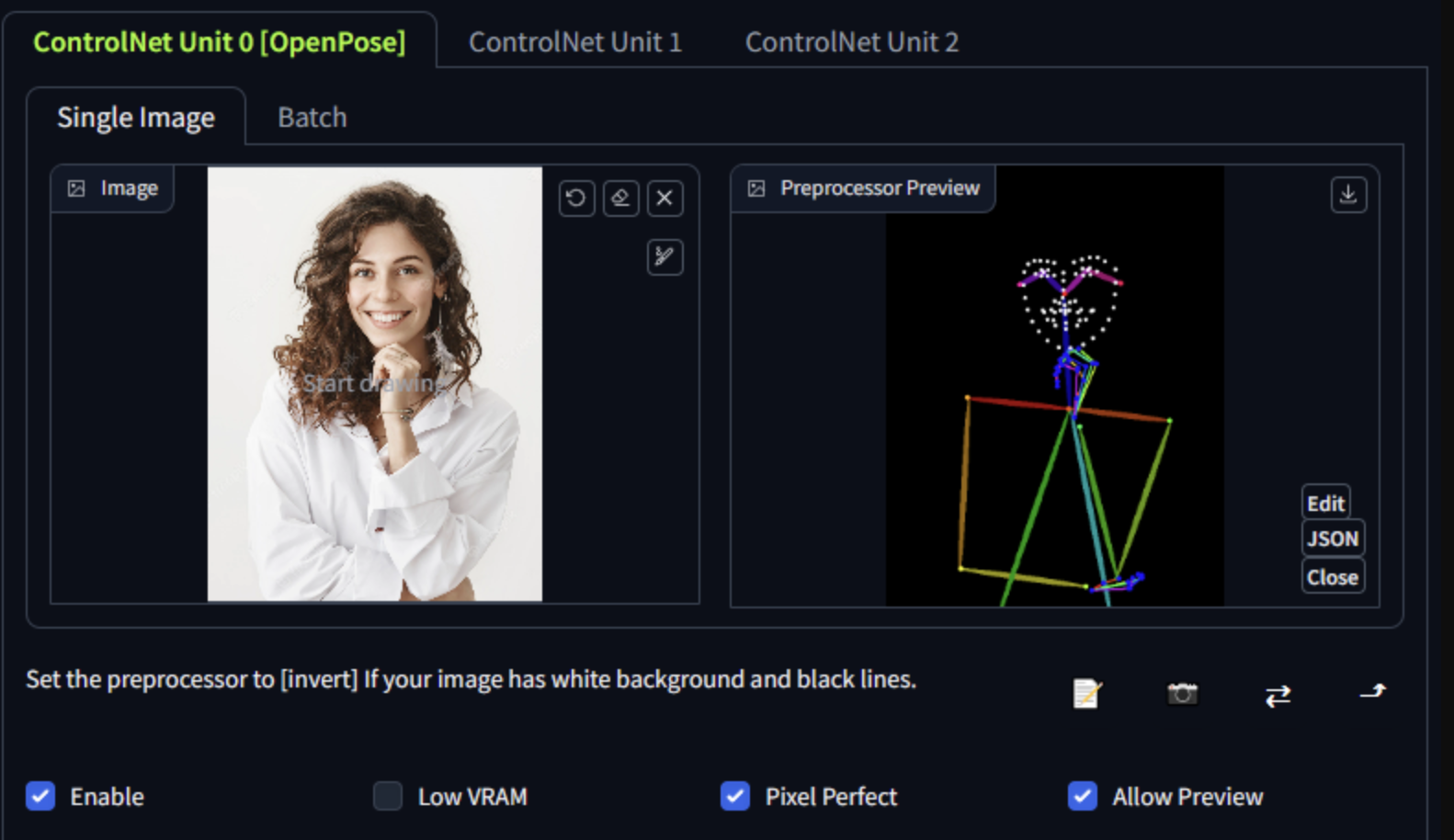

ControlNetの最も強力な機能の一つは、顔画像から全身と環境を作成する能力です。これは、プラスフェイスモデルとオープンポーズを使用した2つ目のControlNet画像を使用して実現されます。この機能により、ユーザーは被写体の体と顔の角度をより制御することができ、よりリアルで詳細な画像を作成することができます。ControlNetの詳細やインストール方法については、Stability AIのウェブサイトを参照してください。

まとめ

この記事は、AIアート制作者やデザイナーにとって、AI技術を活用して新しいアートワークを作成するための新たな方法として、Stable DiffusionとControlNetの使用方法について解説しました。これらの技術を活用することで、これまでにないレベルの精度と制御を実現し、AIアートの新しい可能性を広げることができます。